Jugendschutz Dickpics: Instagram will vor Nackt-Nachrichten schützen – aber aus anderen Gründen als Sie denken

Instagram warnt nun beim Empfang von Nacktbildern – und beim Versand

© Instagram / PR

Nacktbilder zu verschicken, ist nach wie vor weit verbreitet – auch bei Jugendlichen. Die sollen nun bei Instagram besonders davor geschützt werden. Aber auch alle anderen profitieren von der neuen Regelung.

Die Bilder sind schnell verschickt – und haben oft dramatische Folgen. Nicht nur Instagram hat ein Problem mit Nacktbildern, die von den oft noch jugendlichen Nutzern verschickt werden. Nun will das Bilder-Netzwerk seine Nutzer davor schützen – und das gleich in mehrerer Hinsicht.

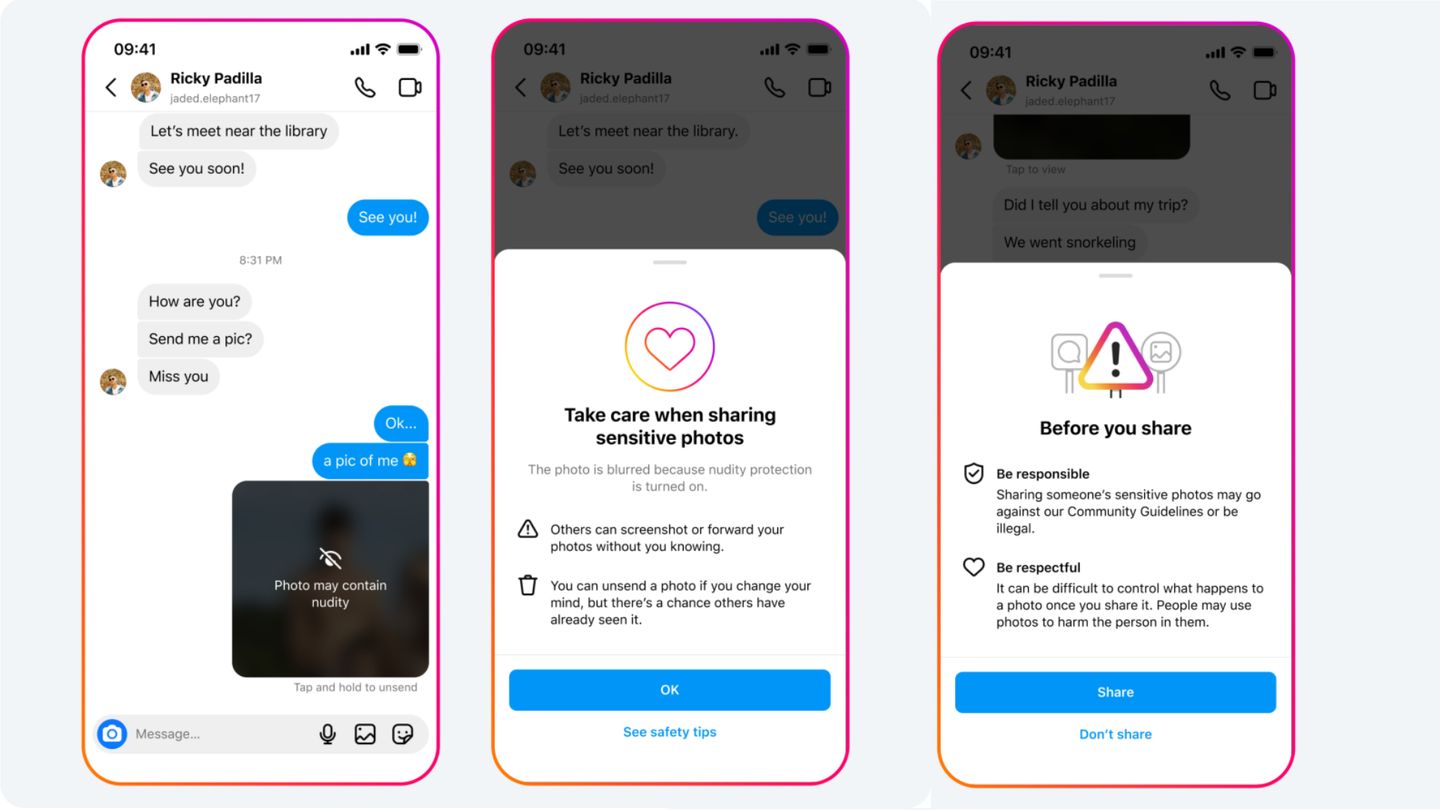

Das kündigte das Netzwerk gerade in einem Blogpost an. Werden in den Direktnachrichten Nacktbilder erkannt, erhalten Minderjährige sowohl als Sender als auch als Empfänger einen Warnhinweis. Zudem werden die empfangenen Bilder zunächst ausgeblendet und erst auf ausdrücklichen Wunsch der Nutzer:innen angezeigt.

Instagram: Schutz vor Nacktbildern – für beide Seiten

Vor allem letzteres dürfte bei vielen Nutzer:innen begrüßt werden. Schließlich gehören unerwünschte Penis-Fots, sogenannte Dickpics, vor allem für weibliche Nutzer zum traurigen Social-Media-Alltag. Statt direkt das Bild zu sehen, kann man es nun einfach ignorieren – oder auf Wunsch eben doch anzeigen lassen.

Eigentlich geht es Instagram aber um den ersten Aspekt: Den unbedarften Versand der Bilder. Laut dem Blogpost kommt es immer wieder dazu, dass Jugendliche sich zum Versand von Nacktfotos überreden lassen – und dann damit erpresst werden. Das geschieht nicht nur unter Bekannten: Es soll regelrechte Banden geben, die professionell die Naivität der Opfer zu Geld machen.

Dem soll die neue Warnung einen Riegel vorschieben, so das zum Facebook-Mutterkonzern Meta gehörende Unternehmen. Die Warnung erinnert an die möglichen Folgen eines verschickten Nacktbildes, betont, sich nicht dazu überreden zu lassen. Will man es trotzdem verschicken, geht das aber auch weiterhin.

KI-gestützt

Zur Erkennung von Nacktbildern setzt Instagram auf Künstliche Intelligenz. Die Erkennung der Nacktbilder soll dabei direkt auf dem Gerät erfolgen, also auch bei einer verschlüsselten Verbindung funktionieren, betont Instagram in dem Blogpost.

Die Schutzmaßnahme soll bei allen Accounts von Unter-18-Jährigen automatisch aktiviert werden, steht aber auch allen anderen Nutzer:innen als optionale Einstellung zur Verfügung. Einen genauen Zeitplan für das Feature nennt der Konzern aber noch nicht.

Schutzmaßnahme – auch für Insta

Neben der Erkennung von Nacktbildern kündigte Instagram noch einige weitere Schutzfunktionen für die Accounts Minderjähriger an. So soll die Kontaktmöglichkeit für Accounts eingeschränkt werden, mit denen die Jugendlichen nicht bereits verbunden sind. Zudem versucht das Netzwerk, Betrüger und sexuelle Erpresser aktiv an ihrem Verhalten zu identifizieren und warnt schon bei Verdacht vor Kontakt mit diesen Accounts. Verhärtet sich der Verdacht, können die Konten auch ganz von der Plattform entfernt werden.

Ein Aspekt der Schutzmaßnahmen dürfte auch der Selbstschutz der Plattform sein: Der Versand von Nacktbildern Minderjähriger ist in vielen Ländern illegal – auch wenn die Personen Bilder von sich selbst verschicken. Instagram hat also auch selbst ein Interesse daran, die Zahl der so verschickten Bilder so deutlich wie möglich zu senken.

Besonders groß ist diese Gruppe bei Instagram allerdings nicht mehr. Obwohl das Netzwerk etwa im Vergleich zu Facebook ein noch relativ junges Publikum hat und Nutzer ab 13 auf der Plattform erlaubt, beträgt der Anteil minderjähriger Nutzer nur knapp acht Prozent. Zum Vergleich: Der bei Jugendlichen besonders beliebte Konkurrent Tiktok bringt es auf 25 Prozent minderjährige Nutzer:innen.

Quellen:Instagram, New York Times, Hootsuite